Llevamos ya varios meses de travesía por el desierto con el tema de la memoria RAM. La culpable de esta situación es la dependencia extrema de los modelos de lenguaje o IA que requieren enormes cantidades de este tipo de componente para que sus empresas puedan entrenarlas y mejorarlas. Sin embargo, puede que haya una luz al final del túnel que pueda complacer a ambas partes: a los usuarios de PC corrientes y molientes y a las empresas que desean ganar la batalla por presentar la mejor Inteligencia Artificial.

Google ha presentado una nueva tecnología de compresión para los grandes modelos de lenguaje: TurboQuant; un algoritmo que reduce seis veces la cantidad de memoria RAM necesaria para que una IA opere a niveles óptimos. Sin ralentizaciones ni pérdida en la precisión de sus respuestas. Y si bien el impacto económico ya ha empezado a notarse en el sector de la RAM, hay ciertos detalles que deberían aconsejarnos cautela con nuestras expectativas.

TurboQuant: Misma eficiencia, menos RAM

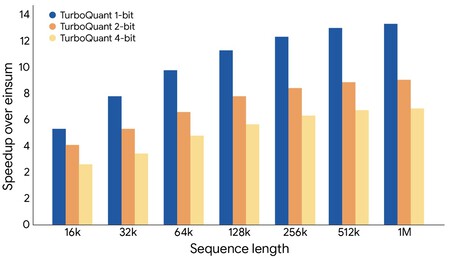

En términos llanos, lo que hace TurboQuant es reducir el consumo de memoria de los modelos de lenguaje al tiempo que mantiene la velocidad y la precisión de estos. Lo hace modificando cómo han estado almacenando y procesando los datos las IA hasta ahora. En lugar de usar los métodos tradicionales para gestionar los vectores de activación (los datos que la IA necesita tener "a mano" para responder), TurboQuant aplica un proceso que consta de dos pasos.

El primero es convertir esos vectores en coordenadas más simples. Para que nos entendamos, los vectores tradicionales utilizan los tres valores de las tres dimensiones: ancho (X), alto (Y) y profundidad (Z). Pero mediante PolarQuant, una subrutina interna de este nuevo algoritmo, lo que se consigue es reducir esos vectores a dos datos: un radio y una dirección. Por ejemplo, en vez de decirle a una IA "Ve tres espacios al este y cuatro al norte", lo que le dice es "Avanza cinco espacios a 37 grados". Es un ejemplo muy simple que ayuda a entender que, a menor número de instrucciones, menor memoria RAM es requerida para conseguir el mismo objetivo.

Imagen: Google Research

Imagen: Google Research

El segundo paso consiste en la eliminación de errores que aparecen naturalmente al comprimir estas instrucciones. Mediante el uso de una técnica llamada QJL (Quantized Johnson-Lindenstrauss), el algoritmo consigue que cada dirección de vector solo requiera de 3 bits frente a los 16 o 32 que los modelos actuales suelen utilizar. En esencia, está ocupando mucho menos espacio en la memoria para almacenar las instrucciones, repasarlas y aplicarlas. Sumando estos dos pasos, la IA mantiene su eficiencia y velocidad de respuesta pero necesitando un 80% menos de memoria RAM de la que empleaba hasta ahora.

Un impacto que ya se ha notado en los mercados, y dos posibles desenlaces

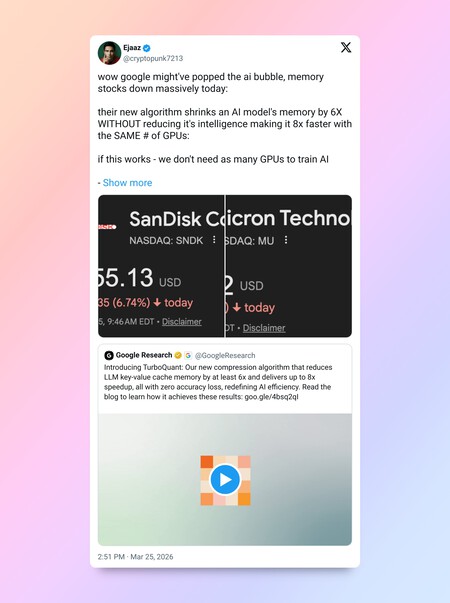

¿Y cómo afecta esto al mercado y al usuario que va tan desesperado buscando un stick de memoria RAM? Pues de momento parece ser que está inclinando la balanza a la normalización de los precios, aunque sea por el susto inicial de los inversores. Justo después del anuncio de Google, los valores en bolsa de gigantes como Micron y Western Digital (propietaria de SanDisk) han sufrido caídas que han rondado el 4% y el 6% respectivamente.

Si bien no son los desplomes apocalípticos que algunos vaticinaban en redes sociales, como el insider especializado en tec y finanzas Ejaaz sí es una señal clara de que el mercado teme que la demanda masiva de módulos por parte de las Big Tech pueda frenarse. Al momento de escribir estas líneas, los valores se han estabilizado ligeramente pero continúan a la baja. Hay otros factores implicados en esta inestabilidad, como la situación en Oriente Medio y la tensión en el Estrecho de Ormuz, que afectan directamente al comercio global de componentes.

Sin embargo, hay que tener cuidado con lo que deseamos. Aquí entra en juego lo que en economía se conoce como la Paradoja de Jevons: cuando una tecnología se vuelve más eficiente y consume menos de un recurso, el uso de ese recurso suele aumentar en lugar de disminuir. Si TurboQuant es tan eficiente como Google promete, las empresas podrían ver el cielo abierto para crear IAs diez veces más potentes que vuelvan a devorar todo el stock de RAM disponible, ahora que es "barato" en términos de computación. El escenario es incierto y no hay una resolución que, por ahora, se muestre clara para los que solo queremos ampliar nuestro PC sin que nos cueste un ojo de la cara.

Imágenes de portada: Vitaly Gariev (vía Unsplash)

En 3DJuegos | CD Projekt trabaja en un 'avance revolucionario' para sus RPG que podría cambiar la forma en la que se hacen ciudades

Ver 0 comentarios